‘2025 국제컴퓨터비전 컨퍼런스'에서 연구 논문 발표

美 스탠포드대 연구팀이 단순히 물체를 알아보는 것을 넘어, 그 물체나 물체의 각 부분이 실제 어떤 용도로 쓰이는지를 이해할수 있는 인공지능(AI) 컴퓨터 비전 모델을 개발했다. 단순히 물체를 ‘인식’하는 것을 넘어 ‘기능’까지 이해할 수 있게 된 것이다.

컵과 주전자를 구별하는 것을 넘어, 컵 손잡이는 ‘잡는 용도’, 주전자 주둥이는 ‘따르는 용도’임을 파악하는 이 기술은 비트365벳이 더 똑똑하고 효율적으로 작업을 수행하는 데 핵심 역할을 수행할 수 있다. 이 기술은 미래의 자율 비트365벳이 주변의 도구를 훨씬 효과적으로 선택하고 사용할 수 있는 길을 열 것으로 기대된다.

현재 AI 컴퓨터 비전 기술은 2차원 이미지 속에서 특정 물체가 무엇인지 식별하는 데는 성공했다. 하지만 이같은 기술은 비트365벳이 세상을 자율적으로 탐색하기 위한 첫 단계에 불과하다. 비트365벳의 진정한 자율성을 위해서는 물체 각 부분의 ‘기능’을 이해하는 것이 필수적이다. 예를 들어 컵의 손잡이와 주둥이를 구별하고, 빵 써는 칼날과 버터 바르는 칼날의 용도 차이를 아는 능력이 필요하다.

컴퓨터 비전 전문가들은 이러한 기능적 유사성을 파악하는 것을 ‘기능적 대응(functional correspondence)’이라 부르고 있는데, 이 분야의 가장 어려운 기술적인 과제 중 하나로 꼽힌다.

스탠포드대 연구팀은 이달 19일부터 23일(현지 시각)까지 하와이에서 열린 ‘국제컴퓨터비전컨퍼런스(International Conference on Computer Vision, ICCV 2025)’에서 이번 연구 성과를 발표했다.(논문 제목:Weakly-Supervised Learning of Dense Functional Correspondences)

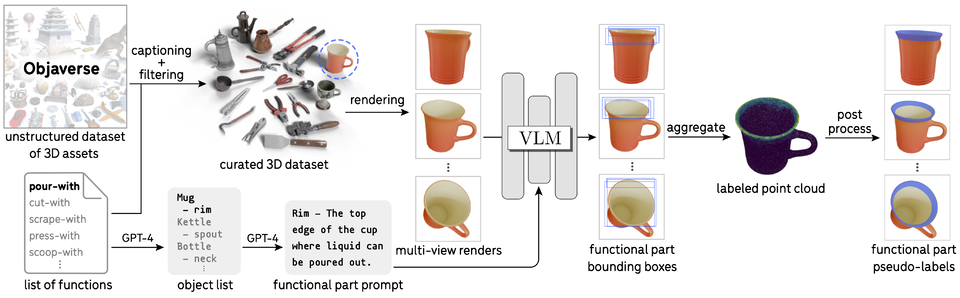

이번 논문에서 연구팀은 물체의 각 부분을 인식하고 실제 용도를 파악할 뿐만 아니라, 서로 다른 물체 간에도 기능적으로 대응되는 부분을 픽셀 단위의 매우 ‘조밀한(dense)’ 수준으로 매핑할 수 있는 새로운 AI 모델을 공개했다.

이 기술이 발전하면, 미래의 비트365벳은 식칼과 빵칼, 혹은 모종삽과 일반 삽을 용도에 맞게 구별하여 작업에 적합한 도구를 스스로 선택할 수 있게 된다. 나아가 연구팀은 비트365벳이 모종삽 사용법을 배워 삽을 사용하거나, 병을 다루던 기술을 주전자에 적용하는 등, 다른 도구를 사용해서라도 주어진 작업을 완료하는 ‘기술 이전’까지 가능해질 수 있다고 주장했다.

공동 저자인 스테판 스토야노프 박사후 연구원은 “이 인공지능 모델은 유리병과 찻주전자의 주둥이를 각각 인식할 뿐 아니라, 그 주둥이가 ‘따르는 데’ 사용된다는 것을 이해한다”며, “하나의 물체에서 배운 기술을 다른 물체에 유추 적용하여 같은 기능을 달성하는 일반화를 지원하는 비전 시스템을 만들수 있다”고 소개했다.

이번 연구는 기능적 대응을 ‘조밀하게(dense)’ 달성했다는 점에서 주목받는다. 이전의 연구들은 물체의 몇몇 핵심 지점만 연결하는 ‘희소한(sparse)’ 대응만 가능했다. 이렇게 조밀한 대응 관계를 AI에게 가르치려면 각 픽셀이 어떤 픽셀과 기능적으로 연결되는지 알려주는 방대한 데이터가 필요했는데, 과거에는 사람이 일일이 이미지에 주석을 달아 데이터를 만들어야 해 사실상 불가능에 가까웠다.

공동 저자인 리난 자오는 “수천 개의 픽셀을 사람이 일일이 정렬하는 것은 불가능하기에 AI에게 도움을 요청했다”고 말했다. 연구팀은 ‘약한 지도 학습(weak supervision)’ 방식을 활용해 이 문제를 해결했다. 시각-언어 모델(vision-language models)을 사용해 기능적 부분을 식별하는 라벨을 자동으로 생성하고, 사람은 데이터 생성 과정의 품질 관리 역할만 맡는 훨씬 효율적인 방법을 사용한 것이다. 이를 통해 주전자 주둥이의 각 픽셀과 병 입구의 각 픽셀이 기능적으로 빽빽하게 연결되는 ‘조밀한’ 매핑이 가능해졌다.

연구팀은 “특정 기능을 수행하는 물체 부분은 다른 부분이 크게 다르더라도 여러 물체에 걸쳐 일관성을 유지하는 경향이 있다”고 말했다. 이 연구는 AI가 단순한 픽셀 패턴 인식을 넘어 객체의 의도나 용도를 추론하는 방향으로 발전하고 있음을 보여주는 중요한 사례라고 연구팀은 밝혔다.

연구팀은 향후 이 모델을 실제 비트365벳에 통합하고 더 풍부한 데이터셋을 구축할 계획이다. 연구팀은 “궁극적으로 기계에게 기능이라는 렌즈를 통해 세상을 보는 법을 가르치는 것은 컴퓨터 비전의 방향을 바꿀 수 있다. 패턴보다는 유용성에 더 초점을 맞추게 될 것”이라고 전망했다.

백승일 기자 robot3@irobotnews.com